This research paper presents the first systematic robustness evaluation of Arabic BERT models against adversarial text attacks, with a focus on the unique linguistic challenges of Arabic — particularly diacritics (Tashkeel).

Key Findings:

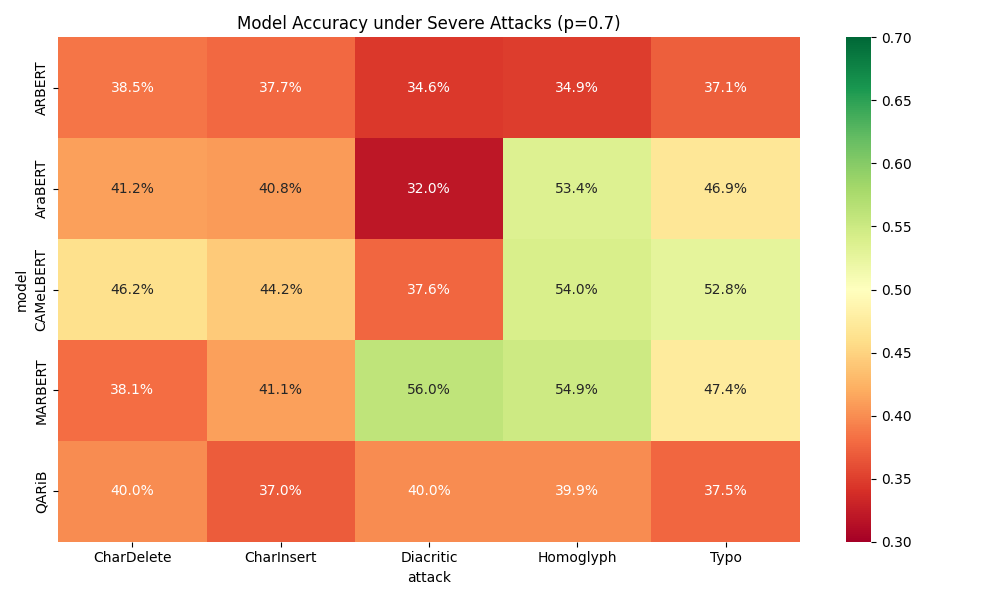

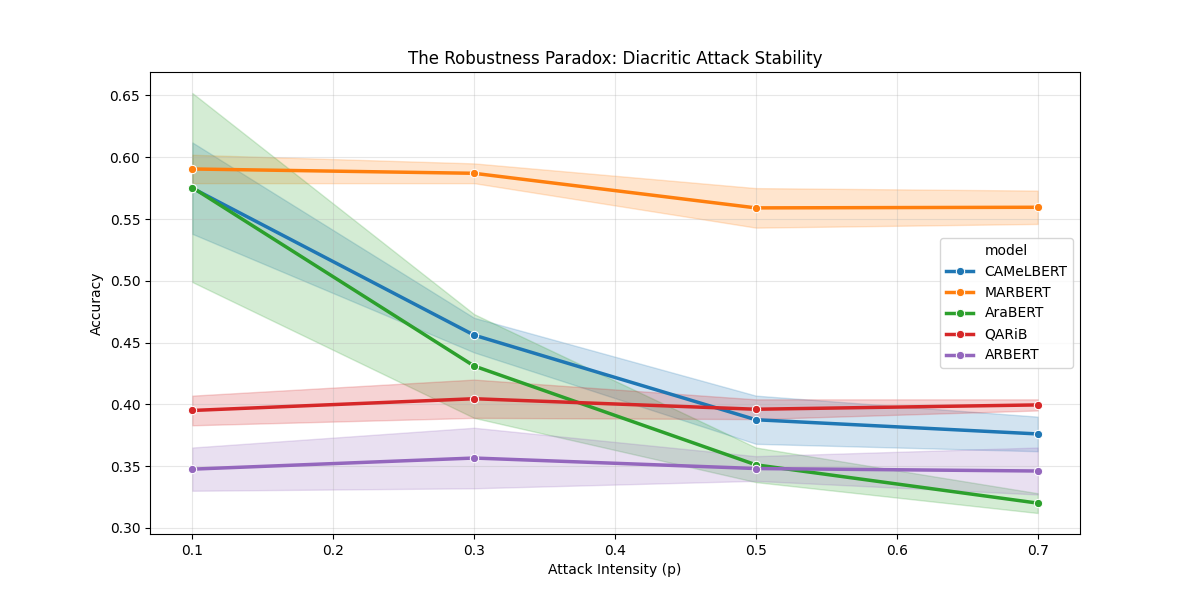

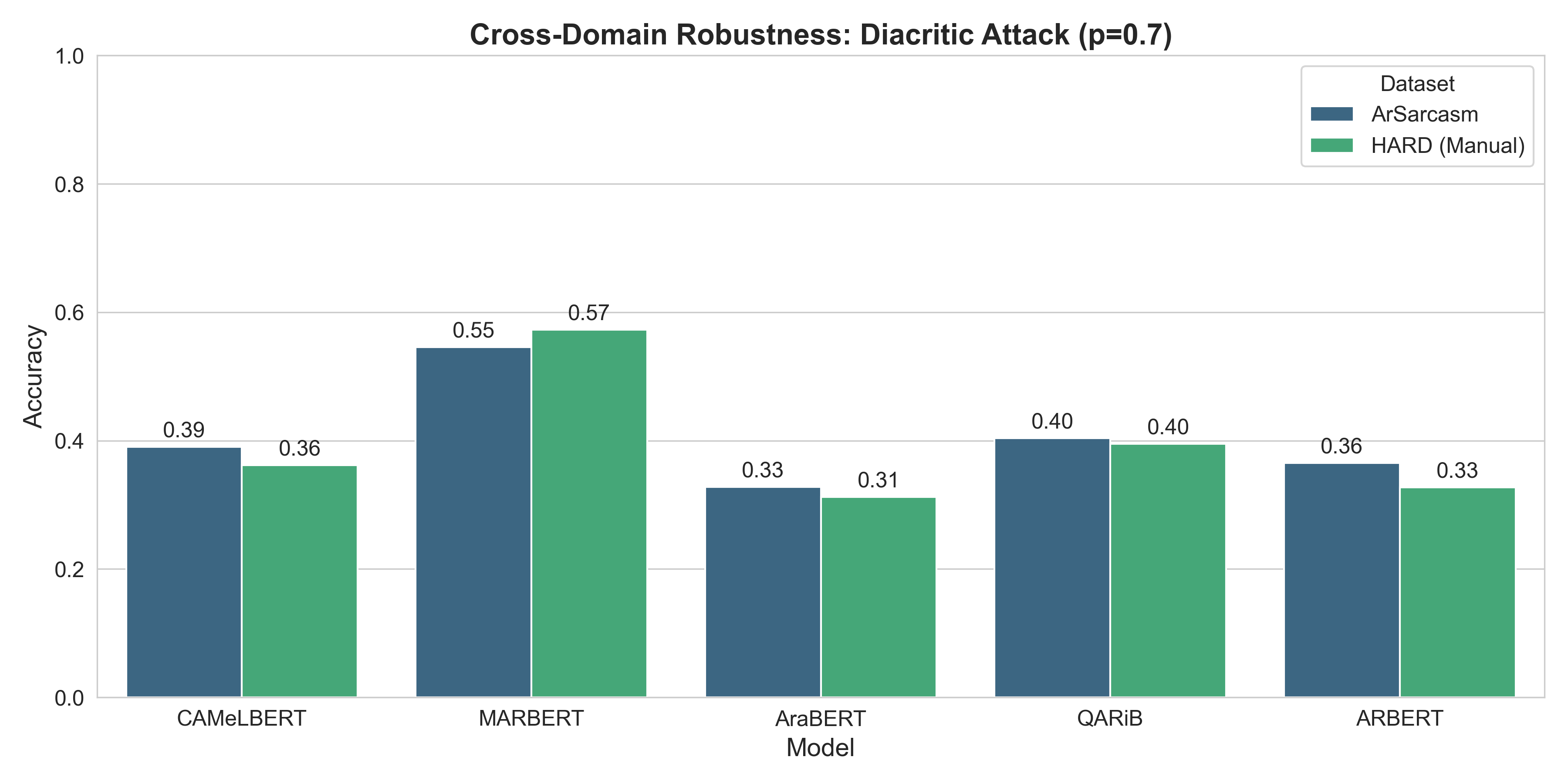

1. High-Performance Fragility: Models with the highest baseline accuracy (CAMeLBERT: 61.2%, AraBERT: 65.2%) exhibit catastrophic degradation under diacritical attacks — performance drops exceeding 22 percentage points.

- Lower-Performance Resilience: MARBERT, despite lower baseline accuracy (57.9%), maintains remarkable stability under diacritical attacks (retention >92%), representing an explicit accuracy-robustness trade-off.

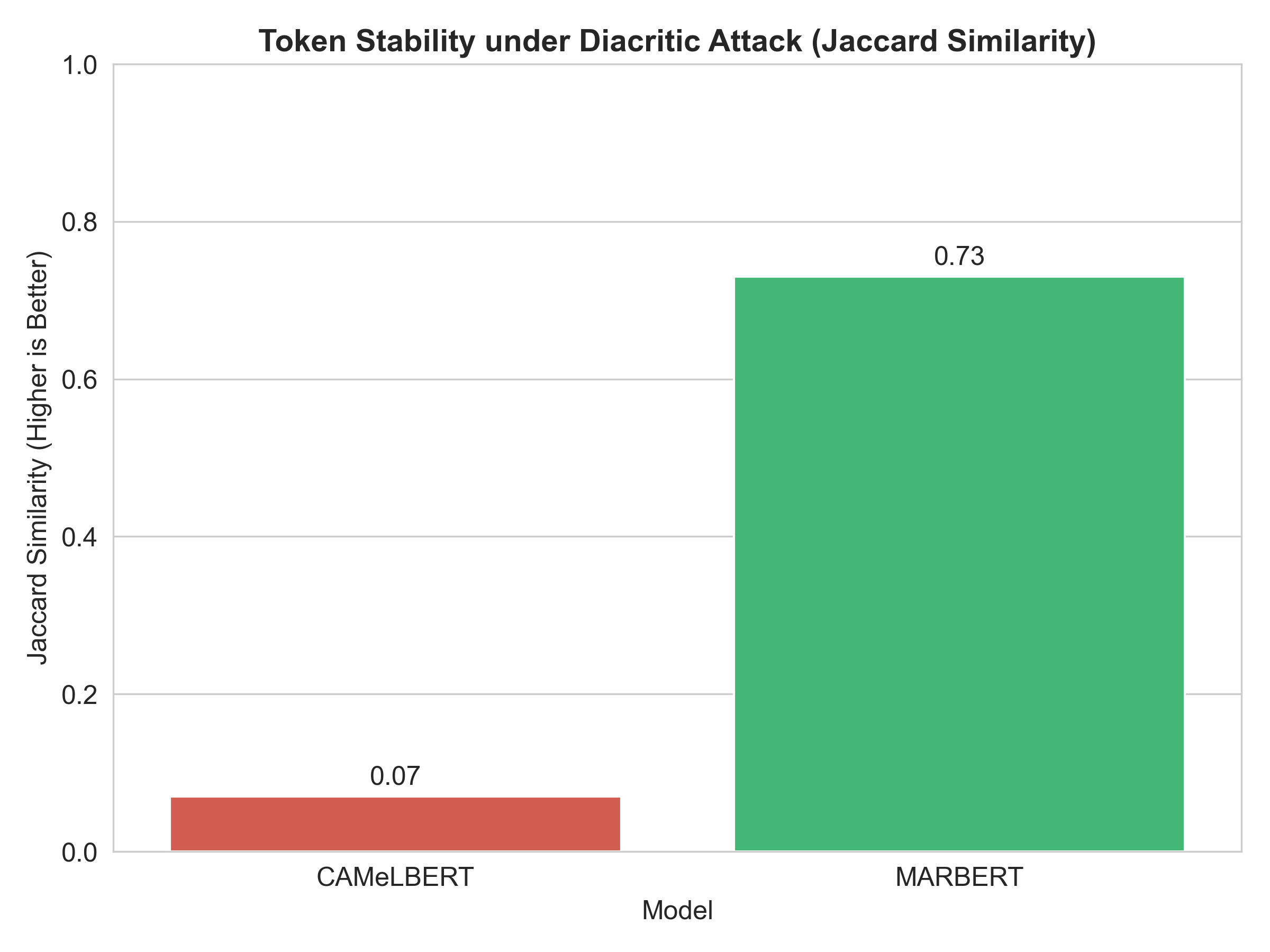

- Tokenizer-Driven Mechanism: The forensic analysis reveals that robustness correlates strongly with tokenizer behavior — MARBERT shows high token stability (Jaccard similarity = 0.73) and minimal UNK explosion (Δ = 2,844 tokens), while CAMeLBERT shows complete token fragmentation.

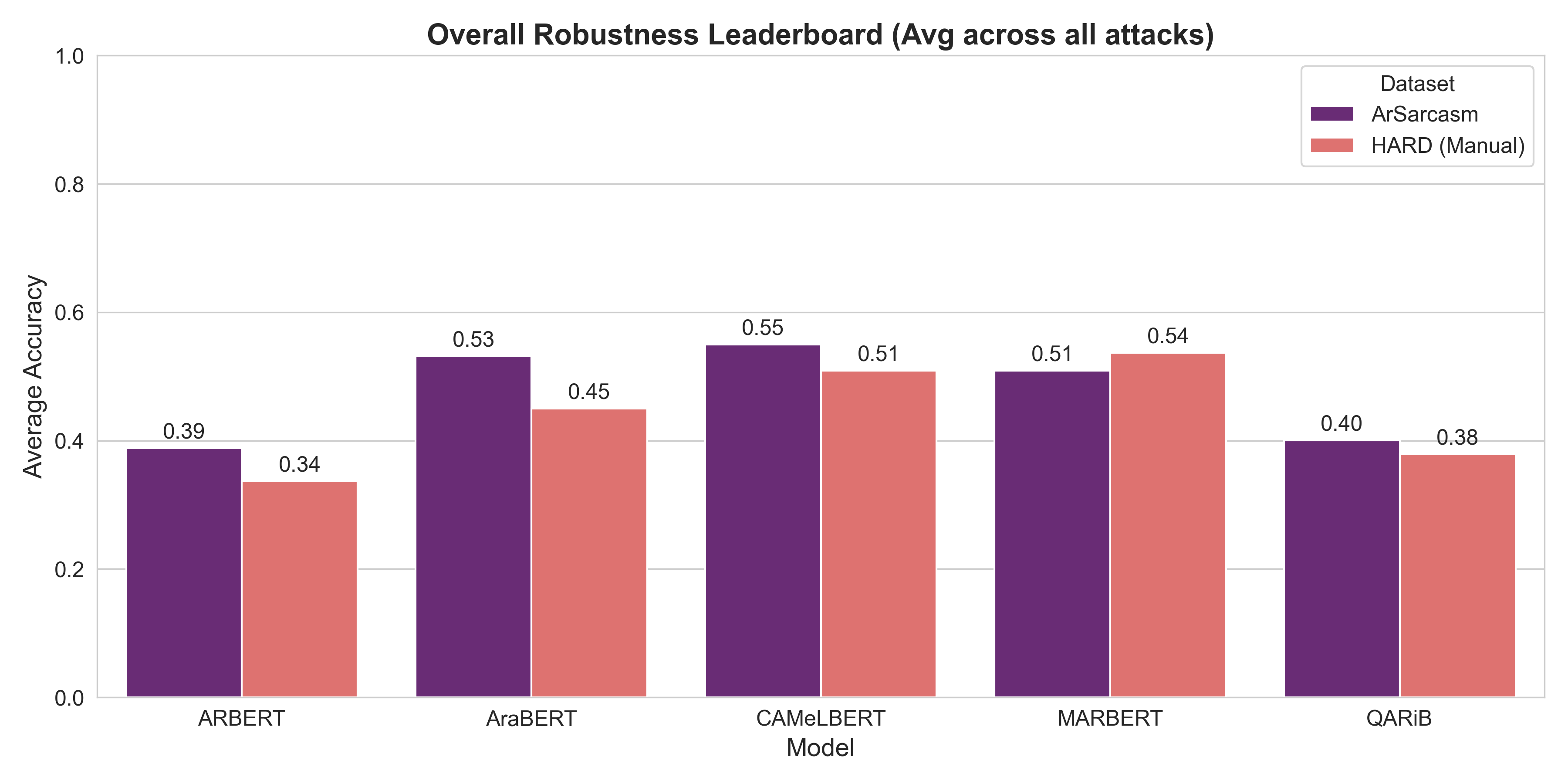

Study Design:

- Total N = 2,000 samples (1,000 Tweets + 1,000 Reviews)

- 5 Arabic BERT models evaluated

- 5 adversarial attack types tested

- Cross-domain validation (social media vs. product reviews)

Keywords: Adversarial Robustness, Arabic NLP, Tokenization, BERT, Sentiment Analysis

تقدم هذه الورقة البحثية أول تقييم منهجي لمتانة نماذج BERT العربية ضد هجمات النصوص الخصومية، مع التركيز على التشكيل (الحركات) كنقطة ضعف فريدة في اللغة العربية.

النتائج الرئيسية:

1. هشاشة النماذج عالية الأداء: نماذج CAMeLBERT وAraBERT رغم دقتها الأساسية العالية تُظهر تدهوراً كارثياً تحت هجمات التشكيل — انخفاض يتجاوز 22 نقطة مئوية.

2. مرونة MARBERT: رغم دقته الأساسية الأقل (57.9%)، يحافظ على ثبات ملحوظ تحت هجمات التشكيل (احتفاظ >92%)، مما يكشف عن مقايضة حرجة بين الدقة والمتانة.

3. الآلية المدفوعة بالمحلل المعجمي: ترتبط المتانة ارتباطاً وثيقاً بسلوك المحلل — MARBERT يُظهر ثباتاً رمزياً عالياً (تشابه Jaccard = 0.73) وانفجاراً ضئيلاً في رموز UNK.

تصميم الدراسة:

- إجمالي N = 2,000 عينة (1,000 تغريدة + 1,000 مراجعة)

- تقييم 5 نماذج BERT عربية

- اختبار 5 أنواع من الهجمات الخصومية

- تحقق عبر مجالين (وسائل التواصل الاجتماعي ومراجعات المنتجات)

Technologies Used

🖼️ Screenshots & Figures